Al doilea început al termodinamicii descrie unele procese din sistemul biologic bazate pe regularități statistice. Cu toate acestea, împreună cu procesele statistice din corp există un set de sisteme mecanice deterministe pentru care alte legi sunt valabile. Regulatitățile statistice determină starea statistică a sistemului, adică entropia este o măsură a tulburării sistemului.

În starea staționară, probabilitatea de a găsi un sistem în ea este 1. Pentru a utiliza conceptul de informație pentru a descrie starea sistemului, este posibil, pe baza conexiunii de informație și entropie, pe care Shannon a stabilit-o. La toate nivelurile sistemului biologic există, apare și acumulează informații, realizarea uneia dintre mai multe stări posibile este percepută ca o anumită cantitate de informații.

astfel comparând expresiile pentru cantitatea de informații și entropie, Shannon a stabilit o legătură.

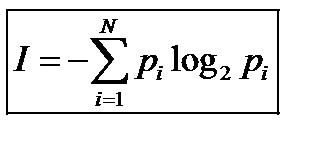

Entropia și informațiile sunt interconectate, însă o astfel de legătură este valabilă doar pentru informațiile care nu pot fi înlocuite. astfel Sistemul de la orice microstat trece rapid într-un alt microstat fără a salva informații. Pentru n evenimente a căror probabilitate este cunoscută, cantitatea de informații încheiată în sistem poate fi determinată de formula:

În sistemul biologic, cu o complexitate tot mai mare, devine posibilă stocarea informațiilor despre starea sistemului. Procesul de memorare a sistemelor libere până la tranzitorii într-una din cele două stări, care este însoțit de pierderi de energie și pentru care este necesar un sistem suplimentar de energie. astfel creșterea informațiilor în sistemele biologice complexe nu este asociată cu creșterea elementelor sistemului, ci prin stabilirea unei legături între elementele sistemului. Cu complexitatea din ce în ce mai mare a sistemului, valoarea măsurării informațiilor, adică imposibilitatea existenței sistemelor fără informații în această stare. astfel sistemul informatic al organismului ar trebui să includă subsisteme de informații statistice și dinamice. Informațiile statistice sunt legate de entropia fizică și sunt o măsură a microstatului sistemelor care nu sunt stocate. Informațiile macro sunt o măsură a acelor state pe care sistemul trebuie să le rețină să rămână.

Articole similare

Trimiteți-le prietenilor: